KI löst Effizienzschub in der Photonik aus

Künstliche Intelligenz (KI) verändert die Wertschöpfung in der Photonik und in deren Zielmärkten. Eine SPECTARIS-Konferenz in Berlin hat Anfang Oktober 2025 wichtige Entwicklungstrends beleuchtet.

Viele industrielle Anwender teilen beim KI-Einsatz das gleiche Ziel: engmaschige, möglichst 360°-Qualitätsüberwachung. Heutige Fertigungsprozesse sind durch Materialvielfalt, hohe Qualitätsanforderungen und komplexe Bauteile und Baugruppen bearbeiten, deren Wert in der Prozesskette steil ansteigt – und das alles bei wachsendem Zeit- und Kostendruck. Im Vergleich zu einer Autotür mit etwa 70 Schweißnähten bei denen Produktionsfehler kaum 100 Euro Schaden anrichten, sind es bei Batterien oder Brennstoffzellenstacks hunderte Schweißverbindungen. Fehler sind Tabu, denn zum Zeitpunkt der Schweißprozesse sind diese teils schon mehrere 1.000 Euro wert, wie Martin Stambke, TRUMPF-Produktmanager für Sensorik berichtete. Dr. Jan-Phillip Weberpals, AUDI-Experte für Laserstrahlprozesse, Sensorik und Machine Learning, und Konstantin Ribalko, Key Account Manager bei Precitec, schilderten auf der Konferenz Ähnliches: „Bei der Zellkontaktierung in Batteriemodulen darf trotz hoher Bandbreite an Materialdicken und Einschweißtiefen keine einzige von hunderten Schweißnähten pro Bauteil schadhaft sein.“

Prozessverständnis, systematische Qualitätskontrolle und Datenverknüpfung

Systematische Qualitätskontrolle soll diesen teuren Ausschuss minimieren. Mit Kamera- und OCT-Systemen, emissionsbasierten Sensoriken, 3D-Bildgebung per Triangulation oder auch Computertomographien überwachen Hersteller Produktionsprozesse. Das kostet, generiert Unmengen an Daten und bereitet den Boden für KI. Industrievertreter formulierten in Berlin, was sie vom KI-Einsatz erhoffen. Zur Fehlervorbeugung soll KI-Parameterkonfigurationen für Prozesse optimieren, in denen KI-gestützte Bildverarbeitung Fehler in Echtzeit erkennt und so den Bedarf an teurer zerstörungsfreier Prüfung minimiert. In Zukunft sollen KI-Lösungen laufende Fertigungsprozesse nachregeln. Das Ziel ist die First-time-Right-Production.

Wie dieses Ziel erreichbar ist, skizzierte Prof. Carlo Holly, Leiter des RWTH-Lehrstuhls für Technologie optischer Systeme und Abteilungsleiter Data Science und Messtechnik am Fraunhofer ILT, in seinem Vortrag. Der Weg führe vom Data Informed Machine Learning zum Data & Physics Informed Machine Learning. „Reine Sprachmodelle, die physikalische Inhalte nur aus Sprache extrahieren – also nur mitlernen – greifen in der Photonik oft zu kurz, weil wir meist schon explizites Wissen über die Physik der Prozesse haben“, erklärte er. Das zu ignorieren und bei null zu starten, sei ein Umweg. Er plädiert daher für direkte Interaktion der Modelle mit der realen physischen Welt. Darin sei der Weg zu autonomen, selbstlernenden Laseranlagen für die Materialverarbeitung methodisch vorgezeichnet.

KI-Aufbruch hat längst begonnen

Dieser Weg ist laut Holly vierstufig. Er hat mit Design und Modellierung unter Verwendung multi-physikalischer Modelle, Raytracing sowie CAD-Tools begonnen, die immer öfter etwa im Optik-Design oder der Bauteil-Auslegung durch KI unterstützt oder optimiert werden. Die zweite Stufe umfaste Prozessmonitoring und Quality Inspection. Inline-Beobachtung liefere jedoch nur rückblickend Fehlermeldungen und Daten über physikalische Abweichungen. Es braucht aber Vorhersagen. Die dritte Stufe umfasst deshalb Prognosen auf Basis vertieften Verständnisses von Fehlerursachen. „Hier angelangt liegt die Stufe vier – der korrigierende aktive Eingriff in den Prozess nahe“, erläuterte er. Die Data Science gebe der Photonik sehr mächtige Werkzeuge an die Hand, die auf viele photonische Prozesse anwendbar seien. So gesehen habe die Zukunft einer KI-unterstützten photonischen Fertigung längst begonnen.

Noch sieht die Fertigungswelt anders aus. Unternehmen generieren große Datenmengen, die aber oft ungenutzt in Datensilos landen oder mit geringen Erkenntnisgewinn ausgewertet werden. Kausalitäten bleiben unklar, Fehlerbewertungen subjektiv, während der Prüfaufwand und die Qualifizierung von Prozessen aus dem Ruder laufen. KI wird benötigt, um die Flut an Daten sinnvoll und nutzbringend zu kanalisieren. Doch ist kein Geist aus der Flasche. Die KI-Implementierung ist eine komplexe strategische und interdisziplinäre Aufgabe. Zunächst gilt es das Nebeneinander von zentraler und dezentraler IT-Infrastruktur, Cloudservices oder die heterogene Datenbasis standortübergreifend zu managen, um Informationen mit Mehrwert aus Rohdaten gewinnen zu können. „Je mehr Daten Sie für ihre KI-Modelle nutzbar machen, desto besser und realitätsnäher werden diese“, so Microsoft-Experte Stephan Kiene. Es sei ein selbstverstärkender Prozess. Die Datenplattform werde zum zentrale Innovationstreiber für Unternehmen. KI-Implementierung setze eine durchdachte Datenstrategie voraus.

Hohe Komplexität in der Photonik

Das gilt branchenübergreifend. In der Photonik kommen heterogene Verfahren und oft nur für ausgemachte Fachleute verständliche Prozesse hinzu. Anwendungen sind so spezifisch, dass vortrainierten Modelle und oft auch die Daten zum Anlernen der KI fehlen. Sie müssen in der Regel selbst generiert werden. Schon hier lauern Fallstricke. Thomas Koschke von der BCT Steuerungs- und DV-Systeme und Max Zimmermann vom Fraunhofer ILT berichteten von einem Projekt, in dem sie KI für die Parametrierung und Kontrolle robotisch unterstützter Laser Metal Deposition-(LMD)-Prozesse trainierten. „Für gute Ergebnisse muss man viele, oft wechselwirkende Parameter einstellen. Wenn der Vorschub und die Laserleistung nicht zusammenpassen, drohen Überhitzung oder unregelmäßige Pulverschmelze“, so Koschke. Alle Varianten für eine optimale Parametrierung zu testen, wäre zu aufwendig. Daher sollte KI bei der Prozess-Einrichtung helfen und dann auch gleich zur Inline-Prozessüberwachung dienen.

Das Generieren der Daten, an denen die KI das Erkennen von Fehlern und die Kontrolle des LMD-Prozesses lernen sollte, erwies sich als schwierig. Zwar ordnete BCT-Software Bilder, Temperatur-, Laserleistungs-, Spannungs- und andere Sensordaten der Bauteil-Topologie korrekt zu. Doch beim Aufbereiten der Daten in einheitliche Formate, Maßstäbe und Skalen fiel ein Problem auf: die Zeitstempel stimmten nicht. Erst nach und nach fand das Team die Ursachen: kleine Unstimmigkeiten in Sensorkonfigurationen oder auch eine verstellte Düse. „Schon bei der Datenerhebung zählt jedes Detail“, mahnte Koschke. „Bevor der Aufbau des Datenmodells mit In-Situ- und Ex-Situ-Daten aus metallographischen Analysen oder von CTs beginnt, müssen alle Unstimmigkeiten geklärt sein“, ergänzte Zimmermann. Denn nur wenn alle Daten zeitlich und räumlich exakt zugeordnet sind, lasse sich das volle Potenzial von KI ausschöpfen. Im Human-in-the-Loop-Ansatz konnte das Team schließlich jene Datenbasis schaffen, mit der die KI-Lösung reifte. Das Resultat sind homogenere Strukturen im LMD-Prozess. „Mit den datenbasierten Vorhersagen bauen wir sauberer auf, kommen den Ziel-Geometrien näher und haben stabilere Prozesse“, berichtete Zimmermann.

Der nächste Schritt ist die Sensorfusion

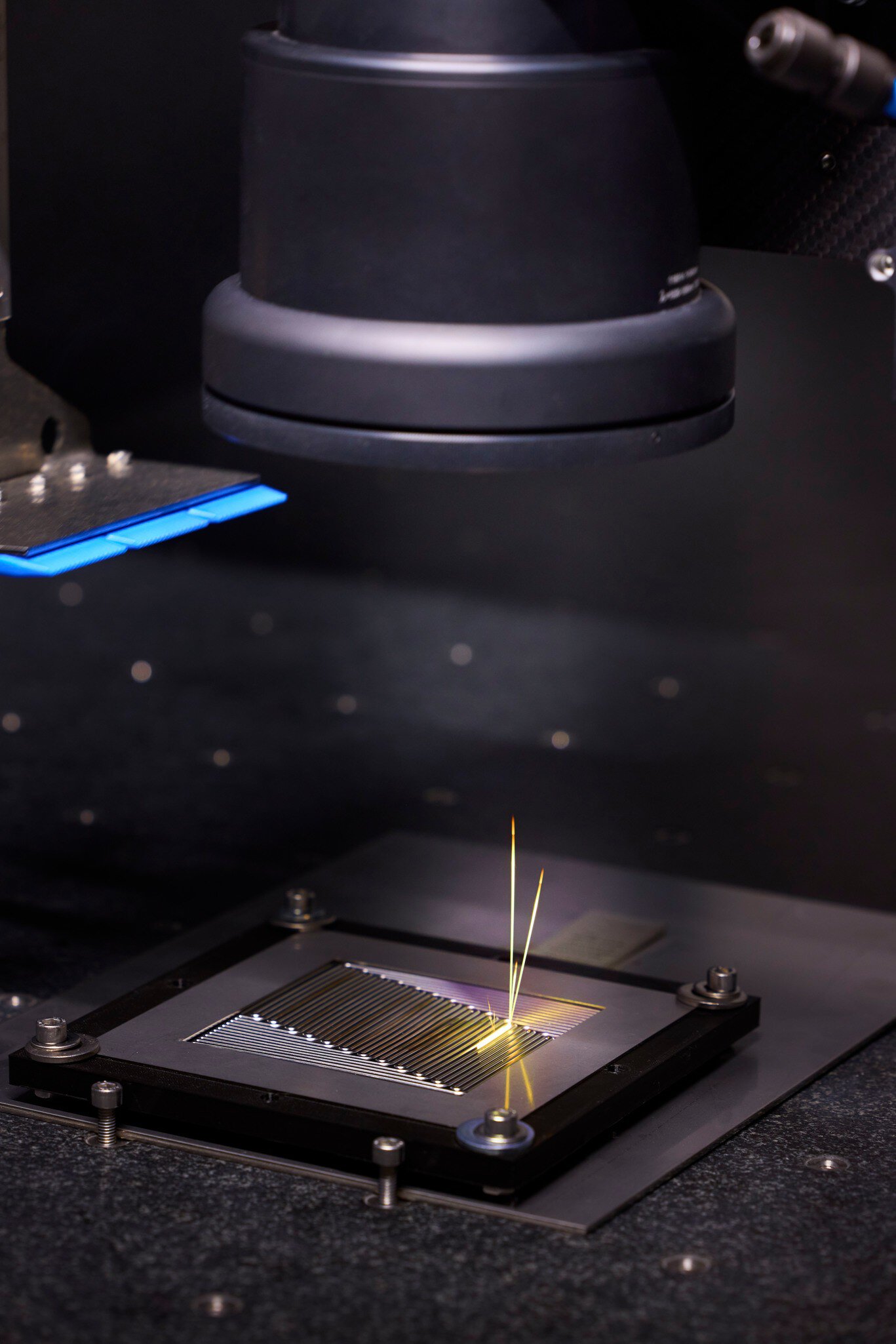

Christoph Franz, Geschäftsführer der 4D Photonics GmbH, stellte in Berlin eine Lösung vor, die das Generieren der Datenbasis mit zahlreichen Sensoren vereinfachen – und die Daten dabei sofort mit präzisen Zeitstempeln versehen soll. Das Ziel ist die volle Rückverfolgbarkeit in allen erdenklichen Laseranwendungen vom Schweißen und Schneiden unterschiedlicher Materialien bis zum Reinigen, Laserabtrag oder zu additiven Prozessen. Die Lösung ist ein faustgroßer Sensor-Würfel mit über 42 Einzelkanälen für eine einfache Sensor-Fusion. „Es geht darum, möglichst viele Prozessdaten zu generieren: Prozessemissionen am Werkstück, Laserleistung, spektral und zeitlich hochaufgelöste Messungen der emittierten Wellenlängen, um Fehler zu detektieren“, erklärte er. Hardware auf der Sensorseite sei der Schlüssel, um KI für die Qualitätskontrolle nutzbar zu machen. Damit die heterogenen Sensordaten nicht auseinanderdriften, versieht der 4D-Sensor sie mit Precision Time-Protokollstempeln im 10-Nanosekundentakt. Analog- oder Digital-Input werden synchronisiert. Einzelsensoren bilden so ein hochpräzises Informationsnetz, in dem keine Prozessinformation verloren geht und dass jede Auffälligkeit mit Zeitstempel versehen dokumentiert. Hinzu kommt eine Software, die Bauteile visualisiert und so vergleichende Analysen beispielsweise von Schweißnähten vereinfacht. Ein Multi-Tool für die Sensorfusion also, das bereits zur Prozessüberwachung in der Batterieproduktion genutzt wird. 4D Photonics arbeitet in diversen Forschungsprojekten mit Partnern aus Industrie und Forschung daran, die Lösung für KI-überwachte Prozesse nutzbar zu machen. Sie soll dann beispielsweise in Schweißprozessen automatisch Poren, Blasenbildung, instabile Keyholes oder Spritzer und Auswurf detektieren. In Versuchsreihen am Deutschen Elektronen-Synchrotron DESY, bei denen laufende Schweißprozesse mit harter Röntgenstrahlung durchleuchtet wurden, habe die 4D-Lösung ihr Potenzial bereits nachgewiesen.

„Synchronisierung der Daten ist absolut entscheidend. Das lege ich jedem ans Herz, der KI nutzen möchte“, betonte Franz. Doch mit präziser Synchronisierung sei Sensorfusion der zentrale Ansatz, um die Zuverlässigkeit und Signifikanz von KI-Analysen und insbesondere der Fehlerklassifizierung deutlich zu erhöhen.

KI im Serieneinsatz

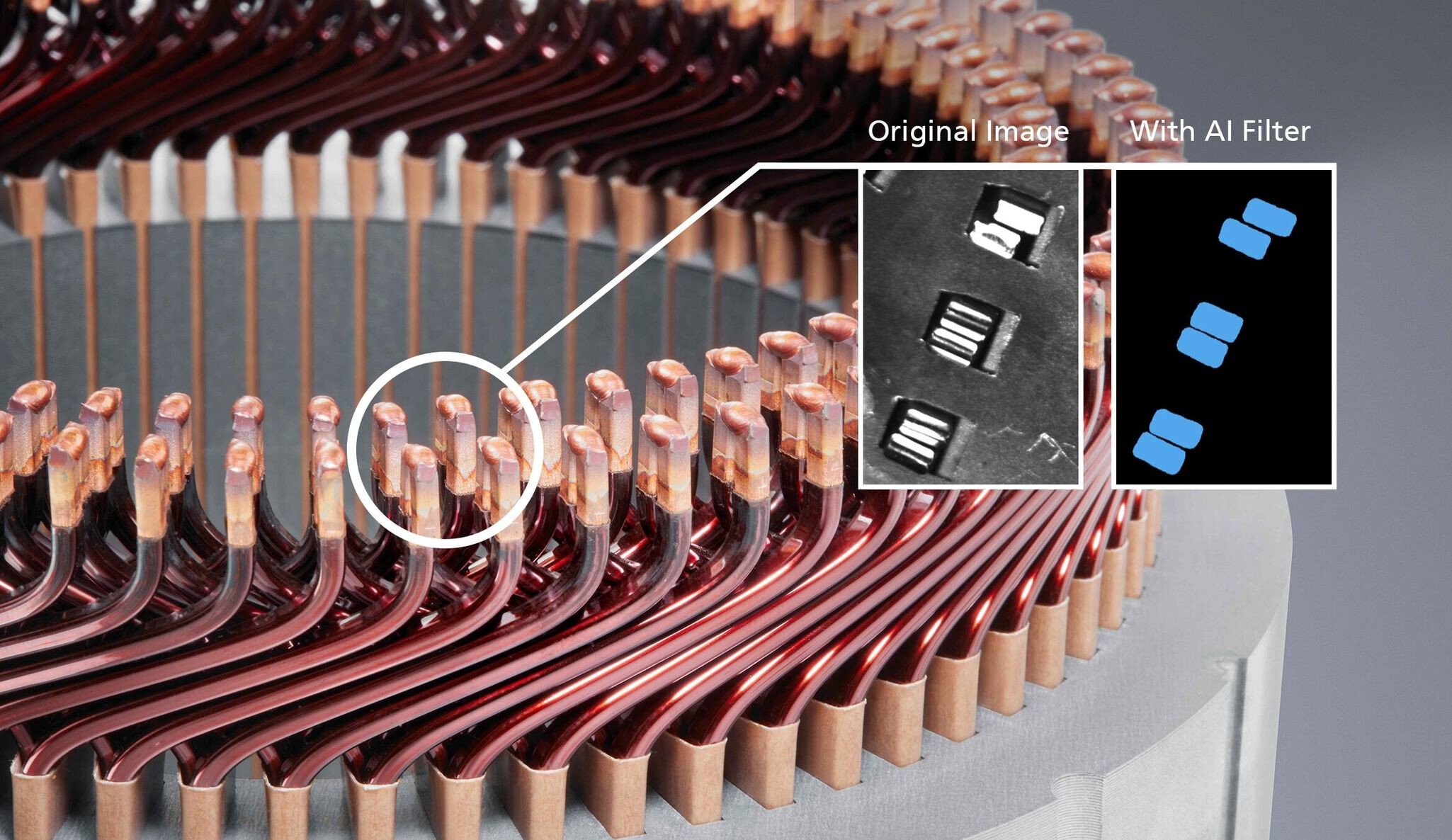

Der TRUMPF-Experte Stambke berichtete in Berlin von KI-Serieneinsätzen. TRUMPF setze auf nutzerzentrierte Lösungen, um auch Beschäftigten in der Fertigung ohne KI-Erfahrungen das Potenzial nahezubringen und sie durch Mehrwerte zu überzeugen. Bildverarbeitung und ihre Algorithmen stoßen in der photonischen Fertigung bisher an Grenzen. Das gilt auch, wo Laser Hairpins in Elektromotoren verbinden. Die Kupferoberflächen reflektieren einfallendes Licht sehr stark. Variierende Teilequalität erschwert das Imaging mit Grauwert-Algorithmen zusätzlich. Doch die zum Ausrichten der nur 50 – 500 µm kleinen Laserspots braucht es sehr präzise Lageinformationen der Hairpins. Neuronale Netze beschaffen diese. Ein „KI-Filter“ trennt auf Basis semantischer Segmentierung das Bauteil vom Hintergrund: Er reduziert die Aufnahme auf ein binarisiertes Schwarzweiß-Bild, in dem der Grauwert-Algorithmus Hairpins zuverlässig erkennt. „Wir schaffen Robustheit, indem wir Bauteil und Hintergrund trennen und Störeinflüsse herausfiltern“, so Stambke. Tests an 9.500 Hairpin-Paaren belegen es: die Kombination von Grauwert-Algorithmus und KI-Filter sorgten für 99,8 Prozent First-Pass-Yield. Den fehlenden 0,2 Prozent lagen tatsächlich fehlerhafte Paare zugrunde. Das ist eine gute Nachricht für alle, die immer komplexeren Fertigungsaufgaben an immer wertvolleren Bauteilen ausführen müssen: KI reduziert die Fehlerrate signifikant – und sorgt dafür, dass Ausschussteile erst gar nicht in den Schweißprozess gelangen.

TRUMPF treibt auch KI-Lösungen auf Basis von Multi-Sensorsystemen voran. So auch beim Schweißen der Bipolarplatten in Brennstoffzellenstacks. Die Platten aus hochlegiertem Stahl zu verbinden ist wegen ihrer komplexen Geometrie, Materialspannungen und folienähnlichen Stärke von nur 75 – 100 µm herausfordernd. Es gilt, mehrere Meter absolut dichter Naht pro Platte bei mehreren hundert Stück pro Stack zu applizieren. „Ist nur eine einzige Verbindung undicht, ist der ganze Stack unbrauchbar“, erklärte Stambke. Die erforderliche 100-Prozent-Prüfung dauere zwei bis drei Minuten. In der Serienfertigung ist das nicht praktikabel. Daher setzt TRUMPF auf KI-gestützte, multisensorische Prozesskontrolle. Hierfür müssen viele Sensorsignale zu einer kohärenten Qualitätsaussage fusioniert werden. Die Kombination einer hochfrequenten Kurzwellen-IR-Kamera und einem Mikrofon in Verbindung mit KI zeigt in Versuchen bereits, dass sie undichte Nähte sehr gut detektiert. Bipolarplatten, die das System für dicht befand, waren dicht. Fehlalarme bewegen sich auf dem Niveau bislang eingesetzter, deutlich aufwändigerer Messmethoden. Es könnte also sein, dass KI und Photonik bald auch einen Produktivitätsschub in der Brennstoffzellenproduktion auslösen.